챗GPT 수준이 이슈이다. 사람이 쓰면 반나절이나 걸리는 글을 챗GPT는 20초만에 쓴다고 하는데 그 수준이 어느 정도인지에 대한 논란이 있다. 어떤 내용인지 자세히 알아보자.

챗GPT 수준에 대한 논란 개요

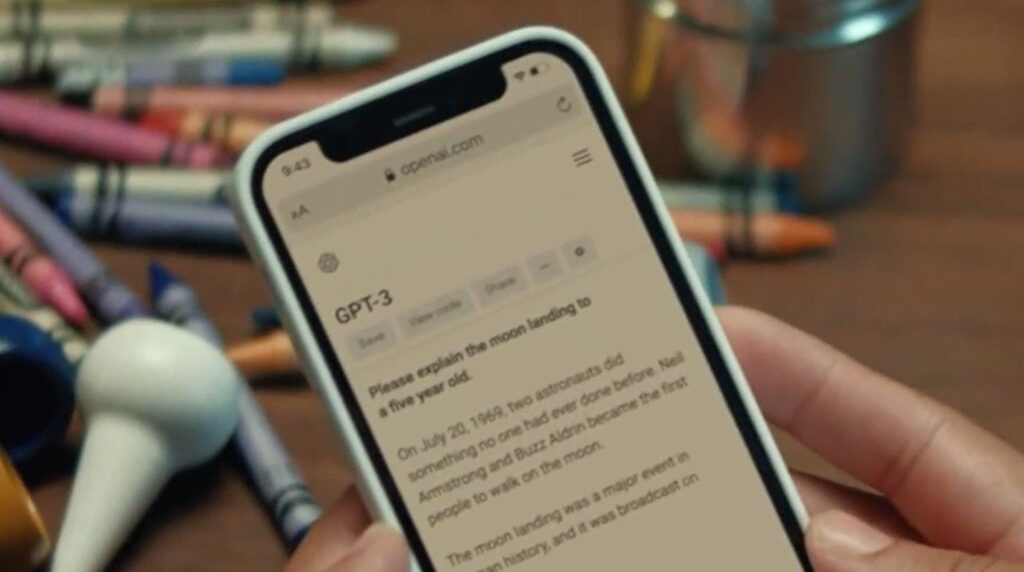

챗GPT에 물어보면 20초만에 글이 써진다. 미국에서는 챗GPT가 법안까지 만들 수 있는 수준이고 판결문도 쓰는 수준이 되었다. 개인이 쓰는 글쓰기 수준 뿐만 아니라 기사나 법안, 판결문까지 사회 규범위 되는 기준들을 이제 챗 GPT가 쓸 수 있는 수준이 되었다.

챗 GTP에 물어보면 팩트 체크도 가능하다. 정확한 출처 정보까지는 알려주지 않지만 사실인지 사실이 아닌지에 대한 판정도 해주고 이에 대한 근거도 써줄 수 있는 수준이다. 그리고 판정 내용도 정확하다.

그런데 이러한 강력한 기능을 가지고 있는 인공지능을 안 좋은 의도로 사용할 가능성도 있게 되었다. 그래서 이러한 우려들에 대해서 결국 인간이 대책을 세우고 해결해야 하는 문제가 되었다.

챗 GPT가 필요한 부분에 대한 코딩을 만들어 달라고 하면 만들어 줄 수 있는 수준이 되었기 때문에 심지어 컴퓨터 바이러스를 만드는데 악용될 수 있다.

챗GPT 수준에 대한 내용

챗 GPT 기술은 대학가에서도 새로운 화두이다. 인공지능의 수준을 확인한 사람들은 놀라고 있는 상황이다. 대학교 수준의 과제에 대해서도 챗 GPT가 실제 대학생이 작성하는 것보다 더 수준 높은 과제물을 만들어 내기 때문이다. 구글 검색 수준이 아니라 전략까지도 구체적이고 명확하게 만들어주는 수준이다.

철학, 통계, 수학 문제까지 풀어 낼 수 있기 때문에 전공과 분야를 가리지 않는다.

지금까지 접했던 인공지능과 챗 GPT가 선보이는 인공지능 수준은 확실히 달라졌다. 수준이 너무 높아졌기 때문에 대학교에서도 이를 큰 문제로 보고 있다. 챗 GPT를 이용해서 과제를 작성하거나 사용할 경우 제재하거나 금지하는 움직임도 있다.

하지만 또 무작정 금지하거나 방치하지 않고 제대로 활용하고 발전시킬 기회를 만들기 위해서 노력하는 움직임도 분명히 있는 단계이다.

현재 인공지능 기술과 인공지능에 대한 윤리는 시작 단계이다. 안 좋은 의도로 사용되는 것에 대해서는 법으로 만들어서 규제해야 한다. 기대가 크지만 한편으로는 윤리 문제와 규제에 대한 문제도 해결해야 하는 것이다. 가짜 정보를 만들어 내는 곳에서도 악용될 수 있다.

인공지능 모델을 만드는 회사에 대해서는 정기적인 위험 평가도 반드시 필요하다.